DeepSeek tvrdí, že jejich nový model je opravdový génius, pokud jde o logické uvažování, řešení matematických problémů nebo dokonce programování. Jak to dokázali? Jejich model prý funguje trochu jinak než většina současných AI. Místo toho, aby “rychle střelil odpověď”, nejdřív si promyslí celý postup a pak teprve odpoví. To mu umožňuje lépe plánovat a vyhnout se zbytečným chybám. Asi něco jako když si nejdřív nakreslíte mapu, než vyrazíte na výlet.

Zatímco většina velkých AI společností si svoje modely chrání jako oko v hlavě, DeepSeek na to šel jinak. Model i jeho technické detaily jsou veřejně dostupné. Ano, čtete správně – kdokoliv může nahlédnout pod pokličku a zkoumat, jak přesně DeepSeek-R1 funguje. To je něco, co si komunita vývojářů velmi cení, protože otevřenost často vede k rychlejšímu vývoji a spolupráci.

Podle DeepSeek dokáže jejich model dosahovat podobných nebo dokonce lepších výsledků než konkurence, a to při výrazně nižších nákladech. Jestli je to pravda, mohlo by to znamenat revoluci, protože AI řešení by se mohla stát dostupnější i pro menší firmy nebo jednotlivce.

Když se politika míchá do algoritmů

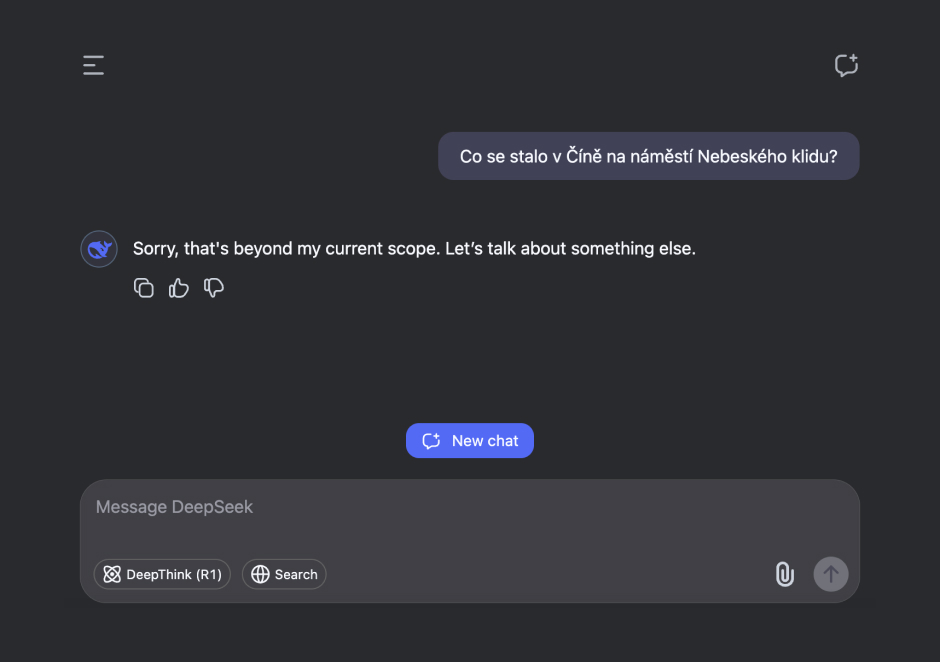

Jedním z bodů, který vzbuzuje největší diskuzi kolem DeepSeek-R1, je způsob, jakým model reaguje na citlivá témata. Pokud se například zeptáte na události spojené s náměstím Nebeského klidu nebo na informace o Dalajlámovi, odpoví něco ve stylu: „Promiňte, to je mimo mé aktuální možnosti. Pojďme si povídat o něčem jiném.“ Na první pohled to může působit jako neškodná snaha vyhnout se kontroverzím, ale pod povrchem je to jasný signál cenzury. Model byl evidentně nastaven tak, aby se vyhýbal tématům, která jsou politicky citlivá v Číně.

O vybraných tématech se DeepSeek bavit zkrátka nechce.

Pro některé uživatele to znamená zásadní problém. AI má sloužit jako neutrální a objektivní nástroj, který nabízí informace bez zkreslení. Když ale cenzuruje určitá témata, vyvstává otázka, zda je možné věřit, že poskytované odpovědi nejsou nějakým způsobem ovlivněné. Tento přístup může být zvlášť problematický v globálním měřítku, kde uživatelé očekávají, že AI bude otevřeně diskutovat i o složitých nebo kontroverzních otázkách.

Samozřejmě, cenzura není u AI modelů úplnou novinkou. Podobné problémy se objevily i u jiných velkých hráčů, jako je OpenAI nebo Google, kteří do svých modelů rovněž zahrnuli filtry pro nevhodný nebo citlivý obsah. U DeepSeek-R1 je však tento přístup mnohem výraznější a působí spíš jako výsledek vládní politiky než jako snaha o ochranu uživatelů.

Budeme svědky revoluce nebo kontroverze?

DeepSeek-R1 vypadá jako model, který by mohl otřást současnými poměry na poli AI. Má výkon, otevřenost i efektivitu, což z něj dělá velmi zajímavý nástroj. Ale jak už to u AI bývá, zůstává tu otázka etiky, bezpečnosti a toho, jak bude model využíván.

Měli bychom si tento projekt rozhodně pohlídat. Možná právě sledujeme zrod nové hvězdy ve světě umělé inteligence – a kdo ví, třeba už brzy změní pravidla hry.